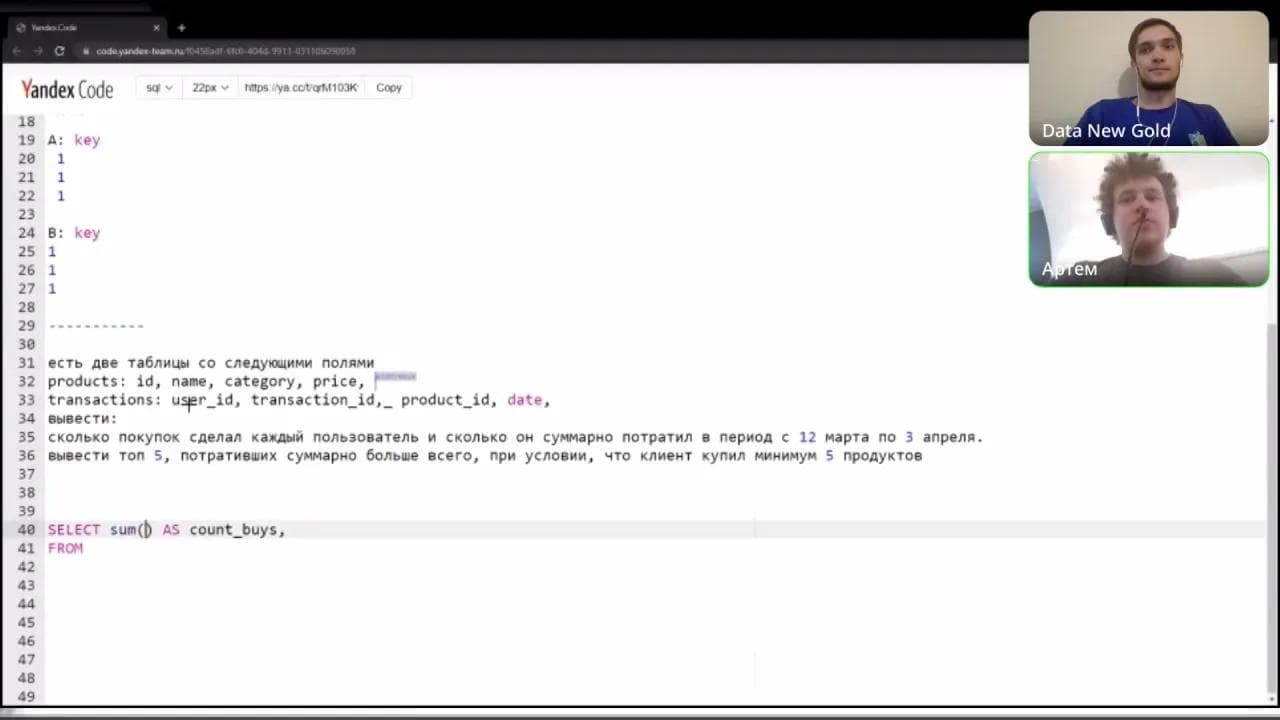

Ответ

Да, я работал с ClickHouse в проектах, где требовалась аналитическая обработка больших объемов данных в реальном времени. Использовал его как основное хранилище для логов и событий.

Основной опыт включает:

- Создание и оптимизация таблиц с движком

MergeTree, настройка партиционирования и сортировки для ускорения типичных запросов. - Написание агрегирующих материализованных представлений для предрасчета часто запрашиваемых метрик.

- Интеграция с Kafka через движок

Kafkaдля потокового приема данных. - Настройка репликации с использованием

ReplicatedMergeTreeдля отказоустойчивости.

Пример создания оптимизированной таблицы:

CREATE TABLE user_events

(

event_date Date,

event_time DateTime,

user_id UInt64,

event_type String,

parameters String

)

ENGINE = MergeTree()

PARTITION BY toYYYYMM(event_date)

ORDER BY (user_id, event_time)

SETTINGS index_granularity = 8192;Ключевые преимущества, которые я использовал — это высокая скорость выполнения GROUP BY-запросов и эффективное сжатие данных.

Ответ 18+ 🔞

А, ClickHouse, говоришь? Да, работал, конечно. Эта штука — просто ёперный театр, когда нужно ворочать овердохуища логов, да так, чтобы запросы летали, а не ползали как улитки в сахаре.

Короче, что я с ним делал:

- Таблицы эти, блядь, создавал и настраивал. Не абы как, а на движке

MergeTree, чтобы всё летало. Партиции пилил по датам, сортировку выставлял под самые частые запросы — иначе нихуя не быстро будет, поверь. - Материализованные представления для агрегаций. Чтобы каждый раз всю эту гору данных не перемалывать, я заранее считал самые ходовые метрики. Экономия времени — просто пиздец.

- Стриминг данных из Кафки. Настроил через движок

Kafka, чтобы события лились как по маслу, без этих дурацких костылей. - Репликацию для надёжности. Использовал

ReplicatedMergeTree, чтобы если одна нода накрылась медным тазом, данные не пропали. Доверия к железу, блядь, ноль, поэтому лучше подстраховаться.

Вот, например, как я обычно таблицу для событий пользователей создавал. Смотри, тут вся магия в ORDER BY и PARTITION BY:

CREATE TABLE user_events

(

event_date Date,

event_time DateTime,

user_id UInt64,

event_type String,

parameters String

)

ENGINE = MergeTree()

PARTITION BY toYYYYMM(event_date)

ORDER BY (user_id, event_time)

SETTINGS index_granularity = 8192;Главная фишка, ради которой всё и затевалось — это скорость. Его GROUP BY запросы просто выносят мозг, как быстро работают. И данные он жмёт так, что места занимает в разы меньше. Честно, иногда сам от себя охуевал, глядя на цифры.